|

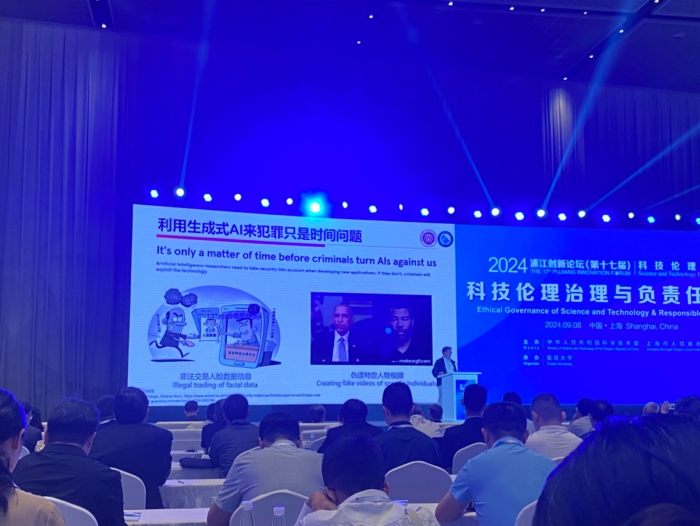

| 面對人工智能帶來的倫理問題,中國工程院院士高文表示,要加強技術研究和制度設計。(圖源:澎湃新聞) |

中評社北京9月9日電/據澎湃新聞報導,9月8日,在2024浦江創新論壇的科技倫理論壇上,中國工程院院士、國家科技倫理委員會委員、人工智能倫理分委員會主任、鵬城實驗室主任高文表示,國內百“模”大戰也消耗了大量資源,“整個社會用電裡,大概1%~3%的耗電用在計算方面。”他建議加強國產算力和國產生成式大模型構建,把開源和閉源模型高效利用起來。

從完整概念提出至今,人工智能的發展歷史衹有68年。高文表示,這68年裡,人工智能經歷了三個階段:第一階段是基於邏輯推理的人工智能,大約經歷了20年;第二階段是基於規則的專家系統階段,這些規則由人類一條條羅列出來,也由神經網絡訓練而來,這個階段持續了大約30年。

從2006年至今是人工智能發展的第三階段,也就是基於深度神經網絡的階段。這一階段實際上又經歷了兩次浪潮,其中第一次浪潮是可用神經網絡對圖像分類的判別式人工智能,第二次浪潮則是從2017年起步的生成式人工智能。

生成式人工智能會帶來深度偽造、詐騙、抄襲、歧視、侵犯隱私和數據安全、“勞動降級”等社會問題。高文表示,判別式人工智能和生成式人工智能如火如荼,但對當前的勞動力市場影響不大,下一輪熱潮很可能是具身智能、人形機器人等,真正對勞動力市場產生大規模影響的,也是這一輪。“如果機器人被大量使用,怎樣使作為勞動力的人仍有工作,是我們必須要面臨的問題。”

高文表示,要從倫理上監管人工智能帶來的社會問題。當前的人工智能倫理面臨兩個派別,一派認為要堅決控制風險,另一派認為現在的人工智能尚未發展到需要立刻踩刹車的階段,現在只需設計好刹車,但不需要踩刹車。

|